A dicembre del 2023, nei primissimi numeri di Artificiale, abbiamo parlato spesso dell’Ai act, il regolamento europeo per le intelligenze artificiali. Il percorso per l’approvazione era ancora in corso; il trilogo – cioè la fase di trattativa fra parlamento, consiglio e commissione europea – era una vera e propria maratona politica.

Già due anni fa avevamo intuito che, fin dal via libera, ci sarebbero stati problemi, incongruenze, ambiguità e meccanismi difficili da applicare. Sembrava che l’Ai act, ben lontano dall’essere una specie di costituzione delle ia valida per tutti, fosse invece molto fragile, spesso difficile da tradurre in regole efficaci e coerenti per governi, aziende e società civile. Ma, soprattutto, era già chiaro che ci sarebbero state molte forze in gioco che avrebbero cercato di plasmare le regole e l’entrata in vigore di prescrizioni e divieti.

Oggi quella stessa legge è di nuovo sul tavolo della politica europea. La Commissione europea, infatti, ha presentato un pacchetto di riforme chiamato digital omnibus. È stato annunciato il 19 novembre 2025 e contiene una serie di proposte per “semplificare” – almeno, questo è l’obiettivo dichiarato – il quadro regolamentare digitale europeo.

Numerose norme toccano proprio l’Ai act, oltre al Gdpr (il regolamento europeo per la tutela della privacy) e il trattamento dei dati. La mossa, che ha comunque basi pragmatiche e concrete, è stata interpretata da molte organizzazioni per i diritti digitali come un arretramento sistematico, il più grande da quando l’Unione europea ha iniziato a legiferare su questi temi.

I cambiamenti più significativi riguardano i sistemi ad alto rischio, quelli che l’Ai act aveva individuato come meritevoli di vigilanza, trasparenza e controlli: applicazioni biometriche, sanitarie, creditizie, usi nei servizi essenziali, nella giustizia, nella sicurezza e nei sistemi che possono avere conseguenze sui diritti fondamentali delle persone.

La proposta prevede di posticipare le due date già fissate (il 2 agosto 2026 per i sistemi ad alto rischio, il 2027 per tutti gli altri) e di far entrare in vigore le norme solo dopo la definizione di standard armonizzati e strumenti di supporto. Come limite ultimo, viene indicata la data del 2 dicembre 2027. Per i sistemi integrati in altri prodotti, invece, si posticipa tutto al mese di agosto 2028.

In pratica, molte delle regole forti dell’Ai act, quelle che avrebbero messo un freno concreto ai rischi strutturali dell’ia, potrebbero essere sospese, forse per anni. A ciò si aggiungono modifiche che riducono gli obblighi di trasparenza; la scomparsa dell’obbligo della cosiddetta ai literacy (formazione sulle ia) per fornitori e utilizzatori; la semplificazione di registrazioni e adempimenti formali; l’estensione delle semplificazioni non solo a piccole imprese, ma anche alle imprese di media grandezza, con meno di 150 milioni di euro di fatturato annuo, che però offrono sistemi ad alto rischio.

Regole alleggerite

Parallelamente, il pacchetto interviene sul Gdpr e sulle norme a tutela della privacy: l’obiettivo è rendere più agevole l’uso dei dati per l’addestramento dei modelli, rafforzare la flessibilità per le imprese, sburocratizzare cookie e tracciamenti, semplificare l’incrocio tra normativa dati e normativa ia.

In particolare, si chiarisce che il “legittimo interesse” può essere una base giuridica che consente il trattamento di dati personali a fini di sviluppo e funzionamento di sistemi di intelligenze artificiali, a patto che vengano rispettate alcune salvaguardie.

Le regole sul consenso ai cookie verrebbero alleggerite: meno banner, più eccezioni, più trattamenti possibili senza consenso esplicito, maggiore libertà di profilazione e analisi anche per scopi statistici, di sicurezza o operativi.

Secondo chi ha scritto il pacchetto, questi cambiamenti servono soprattutto a un obiettivo pratico: sbloccare la capacità innovativa dell’Europa, ridurre i costi e le incertezze giuridiche, alleggerire il carico su imprese, startup e pubbliche amministrazioni, e dunque permettere una più rapida diffusione dell’ia. Le stime presentate parlano di miliardi di euro risparmiati in spese burocratiche entro il 2029.

E in effetti ci sono delle rigidità che andrebbero in qualche modo allentate e la fatica burocratica arriva fino ai cittadini. Ma è importante trovare un equilibrio. Il digital omnibus ha già scatenato un’ondata di critiche di decine di organizzazioni per i diritti digitali, sindacati, associazioni di consumatori, e anche di parlamentari europei. Secondo loro rappresenta la smobilitazione di protezioni che, soltanto un anno fa, l’Europa si era data con orgoglio.

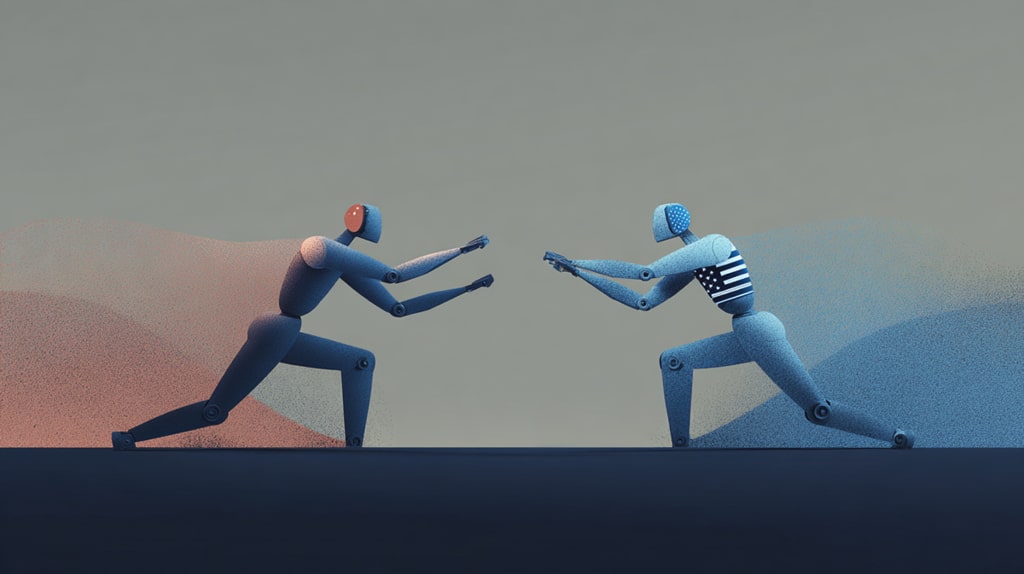

I nodi da cui riparte il dibattito sono due. Il primo è politico, di potere, commerciale e legato a logiche capitalistiche: favorire a tutti i costi la competitività – e con essa le grandi aziende tecnologiche, a cominciare da quelle statunitensi – anche a costo di diminuire garanzie e limiti sull’uso dei dati e dell’ia.

Il secondo è pratico e sociale: con queste modifiche, il progetto europeo di regolazione dell’ia rischia di svuotarsi, lasciando campo libero a dinamiche di sfruttamento dei dati, profilazione di massa, decisioni automatizzate opache.

La situazione è ancor più ingarbugliata se si considera che l’Ai act non affronta in maniera esaustiva alcuni problemi molto importanti delle ia contemporanee: la qualità dei dati, la trasparenza, l’equità, la governance pubblica di modelli generativi e di sistemi generali, il loro uso nell’industria bellica.

Tempo sprecato

In un lavoro recente, autori che analizzano la norma segnalano che termini come “trasparenza”, “spiegabilità” e “interpretabilità” sono usati in modo interscambiabile e ambiguo, e che l’effetto reale delle regole è incerto anche con la versione già approvata dell’Ai act. L’idea di rinviarne ulteriormente l’applicazione è una decisione politica, secondo molti dovuta alle grandi pressioni lobbistiche delle aziende statunitensi.

Ora comincia una nuova trattativa: perché il digital omnibus e le sue modifiche all’Ai act diventino legge serviranno altri mesi di negoziati tra stati membri, parlamento, governi nazionali e commissione.

La sensazione è che si sia sprecato e si sprecheranno altro tempo, altri soldi pubblici, altre energie, altro dibattito che si potrebbero dedicare a tutt’altro. Se davvero l’obiettivo fosse evitare che i 27 paesi dell’Unione europea restino indietro nella corsa tecnologica globale, ci vorrebbero misure concrete, orchestrate in chiave strategica. Non la smobilitazione delle garanzie.

Si potrebbe, per esempio, lavorare alla costruzione di un’istituzione pubblica europea per la ricerca sulle intelligenze artificiali. Un’istituzione seria, trasparente, indipendente, slegata da logiche di profitto, capace di sviluppare modelli in proprio, di definire buone pratiche, di porre l’Europa in una posizione di autonomia tecnologica anziché regredire ogni volta che la pressione del mercato lo richiede.

Ma questa proposta sembra completamente assente dalle idee più diffuse a Bruxelles, anche se ogni tanto qualcuno ne parla.

Questo articolo è tratto dalla newsletter Artificiale.

|

Iscriviti a Artificiale |

Cosa succede nel mondo dell’intelligenza artificiale. Ogni venerdì, a cura di Alberto Puliafito.

|

| Iscriviti |

|

Iscriviti a Artificiale

|

|

Cosa succede nel mondo dell’intelligenza artificiale. Ogni venerdì, a cura di Alberto Puliafito.

|

| Iscriviti |

Internazionale pubblica ogni settimana una pagina di lettere. Ci piacerebbe sapere cosa pensi di questo articolo. Scrivici a: posta@internazionale.it